- 博客

- Genie 3 详解:Google DeepMind AI 世界模型 — 使用教程与全面指南

Genie 3 详解:Google DeepMind AI 世界模型 — 使用教程与全面指南

Genie 3 是 Google DeepMind 推出的实时 AI 世界模型,可从文本生成可交互 3D 世界。了解 Genie 3 的使用方法、Project Genie 演示入口及全部功能。

如果你只需输入一句话,就能在几秒内走进一个会呼吸的 3D 世界——这正是 Google DeepMind 用 Genie 3 实现的事:第一个将纯文本实时转化为可探索环境的 AI 世界模型。

Genie 3 是什么?

Genie 3 是 Google DeepMind 开发的基础世界模型。与依赖手写物理引擎和预制资产的传统游戏引擎不同,Genie 3 完全从视频数据中自主学习世界运行规律。向 Google Genie 3 输入一段文字提示词或一张图片,它便能生成一个可实时导航的完整交互式 3D 环境。

Google DeepMind 于 2025 年 8 月 5 日发布 Genie 3,称其为"世界模型的新前沿"。随后在 2026 年 1 月 29 日,Google 上线了 Project Genie —— 一个面向消费者的原型产品,通过 Google Labs 将 Genie 3 的能力直接带到浏览器中。

Genie 3 现已开放体验

Project Genie 已在 Google Labs 上线,面向美国地区的 Google AI Ultra 订阅用户开放。早期体验阶段无需消耗 AI 积分——只需描述一个世界即可开始探索。

Google Genie 3 代表着迈向通用人工智能的重大突破。通过模拟遵循自学物理规律的环境,Google Genie 3 让研究人员能够在多样化的程序生成世界中训练 AI 智能体,无需昂贵的人工环境设计。

Genie 3 如何运作?

Google Genie 3 采用与大语言模型相同的核心机制——auto-regressive 生成——但将其应用于视频帧而非文本 token。每一瞬间,Google Genie 3 世界模型都会根据此前所有帧以及用户最新操作来预测下一帧画面。

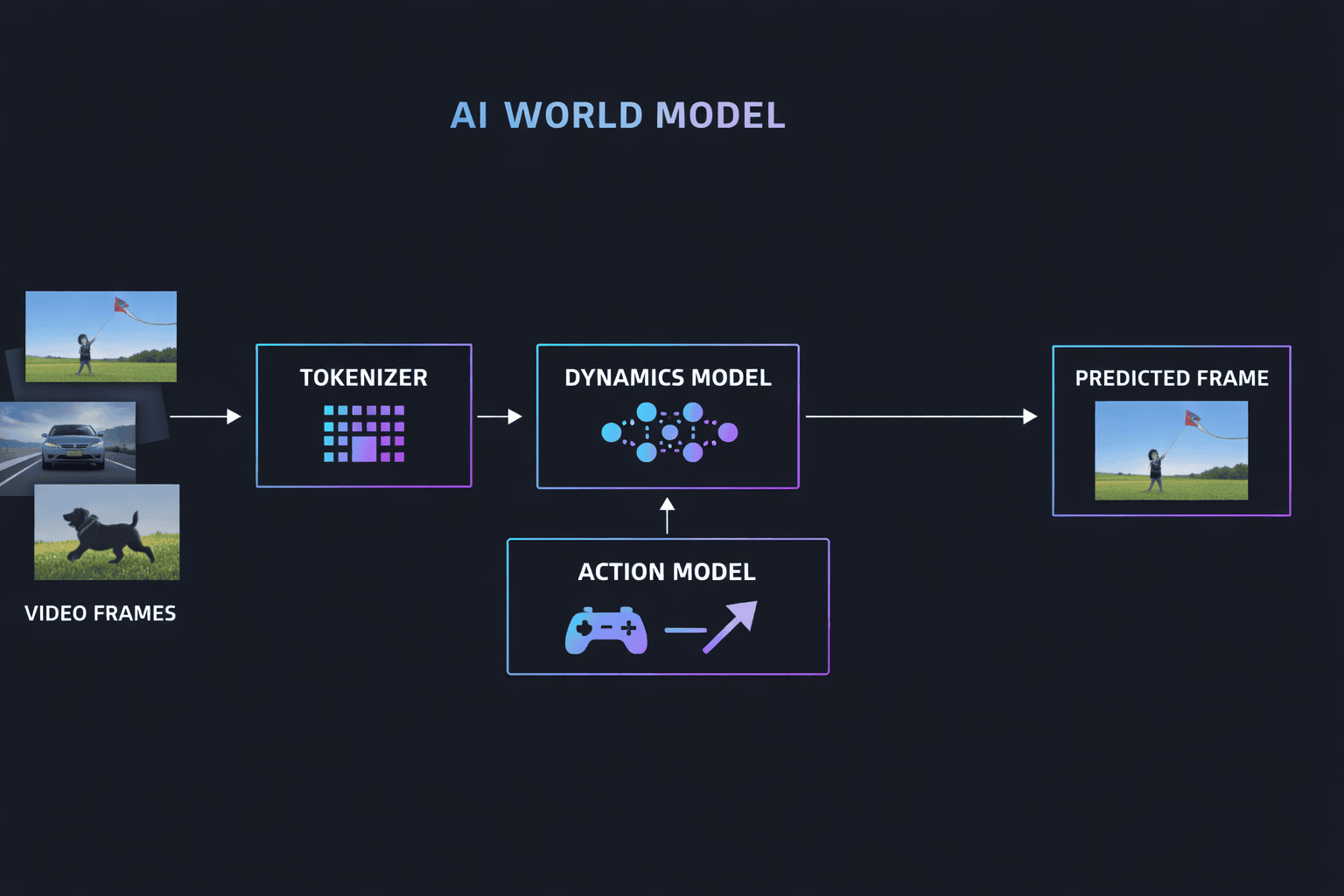

Genie 3 世界模型架构

Genie 3 的架构由三个核心组件协同运作:

- 🔷 时空分词器(Spatiotemporal Tokenizer) — 将原始视频帧转换为紧凑的 token 序列,供 Genie 3 模型高效处理。

- 🔷 自回归动态模型(Autoregressive Dynamics Model) — Genie 3 的核心组件,逐帧预测 token 的演变,有效模拟世界物理规律。

- 🔷 潜在动作模型(Latent Action Model) — 将键盘和鼠标输入映射到 token 空间,使用户(或 AI 智能体)能够与 Genie 3 生成的世界进行交互。

Google Genie 3 的突破之处在于完全没有硬编码的物理引擎。Google Genie 3 世界模型通过在海量无标注视频数据上进行自监督学习,自主掌握了重力、碰撞、光照和空间关系。

Genie 3 实时生成能力

此前的世界模型运行速度不足以支撑实时交互。Google Genie 3 改变了这一切:

- ⚡ 每秒 24 帧 — 在任何 Genie 3 生成的环境中都能流畅、实时地导航。

- 🖥️ 720p 分辨率 — 足以在 Google Genie 3 中进行探索和原型设计。

- 🧠 约 1 分钟视觉记忆 — 如果你在 Genie 3 世界中离开某个位置 60 秒后返回,模型依然记得那里的场景。

- ⏱️ 数分钟持续交互 — 每次 Genie 3 会话都支持超越单次生成窗口的长时间探索。

Genie 3 与 Genie 2:核心差异对比

Google DeepMind 的 Genie 系列快速进化。以下是 Genie 3 与 Genie 2 及初代 Genie 的详细对比:

| 特性 | Genie 1(2024 年 2 月) | Genie 2(2024 年末) | Genie 3(2025 年 8 月) |

|---|---|---|---|

| 输入 | 草图 / 图片 | 单张图片 | 文本提示词 + 图片 |

| 输出 | 简短 2D 环境 | 3D 场景短片段 | 实时可导航 3D 世界 |

| 分辨率 | 低 | 360p | 720p |

| 时长 | 极短 | 10–20 秒 | 单次生成约 60 秒,持续交互数分钟 |

| 实时性 | 否 | 否 | 是 — 24 fps |

| 记忆 | 极少 | 约 10 秒 | 约 1 分钟视觉回溯 |

| 世界事件 | 无 | 无 | 可提示触发(天气、物体、角色) |

从 Genie 2 到 Genie 3 的跨越是巨大的。Genie 2 只能生成简短的非交互片段,而 Genie 3 提供完整的实时探索体验,具备扩展记忆和动态世界修改能力。Google Genie 3 是该系列中第一个真正可以"玩起来"的模型。

Genie 3 核心功能与 AI 能力

以下是 Google Genie 3 在 AI 世界模型中脱颖而出的关键能力:

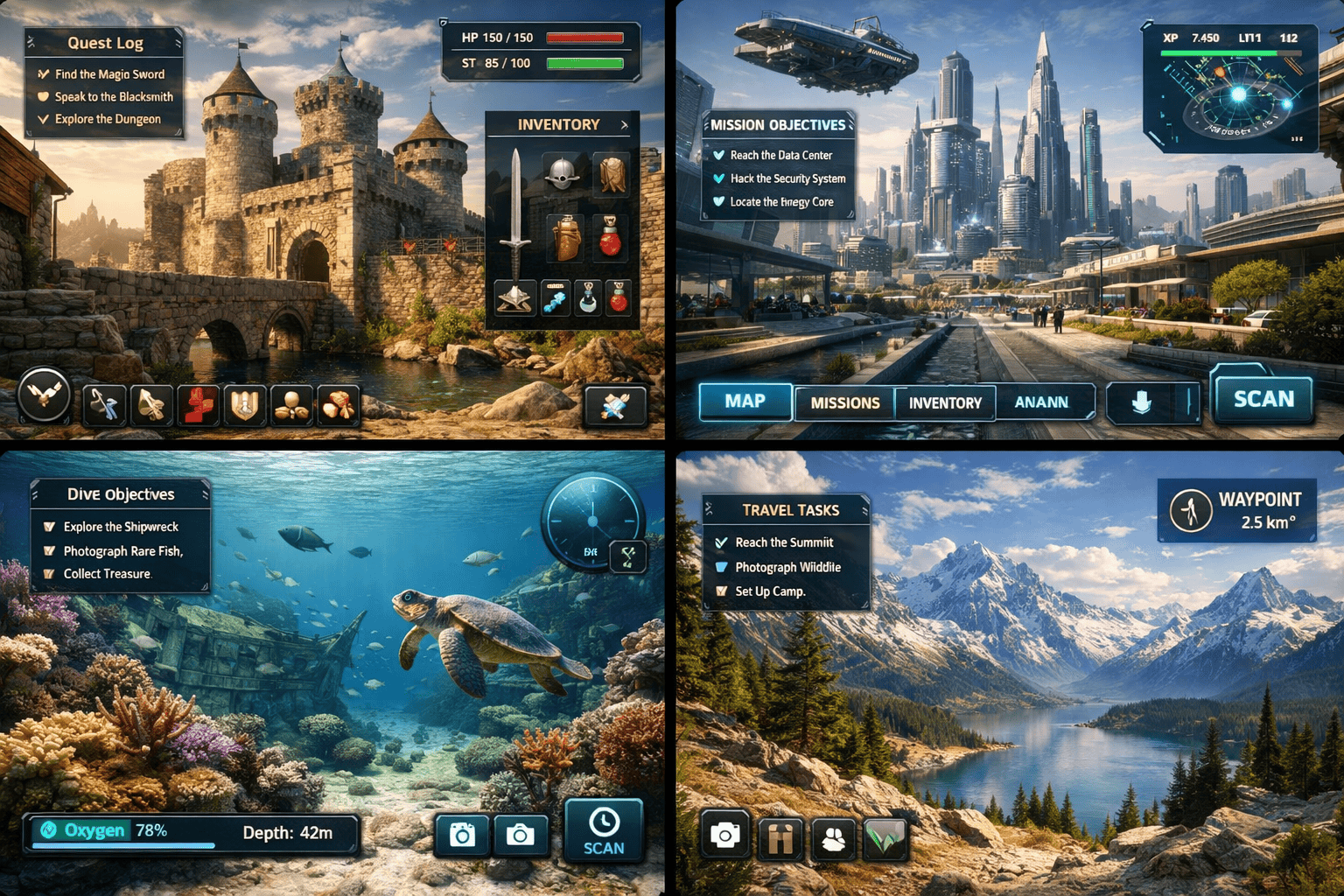

- 🌍 文本生成世界 — 用自然语言描述任何环境,Genie 3 即可构建。月光森林、繁忙的东京街头、外星沙漠——Genie 3 都能胜任。

- 🖼️ 图像生成世界 — 上传参考图片,Genie 3 将其转化为可导航的 3D 空间。

- 🎭 可提示世界事件 — 在探索 Genie 3 世界时,输入指令即可实时改变天气、生成角色或调整整个氛围。

- 📷 摄像机视角控制 — 在 Genie 3 环境中自由切换第一人称、第三人称和等距视角。

- 👤 角色自定义 — 使用 Google Genie 3 时可描述并定制你的世界角色外观。

- 🔬 自学物理引擎 — 没有硬编码规则。Genie 3 从数据中自主发现重力、动量和碰撞。

- 🤖 AI 智能体训练 — Google DeepMind 结合 Genie 3 与 SIMA 智能体,训练 AI 在生成的世界中执行目标任务。

- 🔄 世界混搭 — 通过修改底层提示词来重新改造任何已有的 Genie 3 世界。

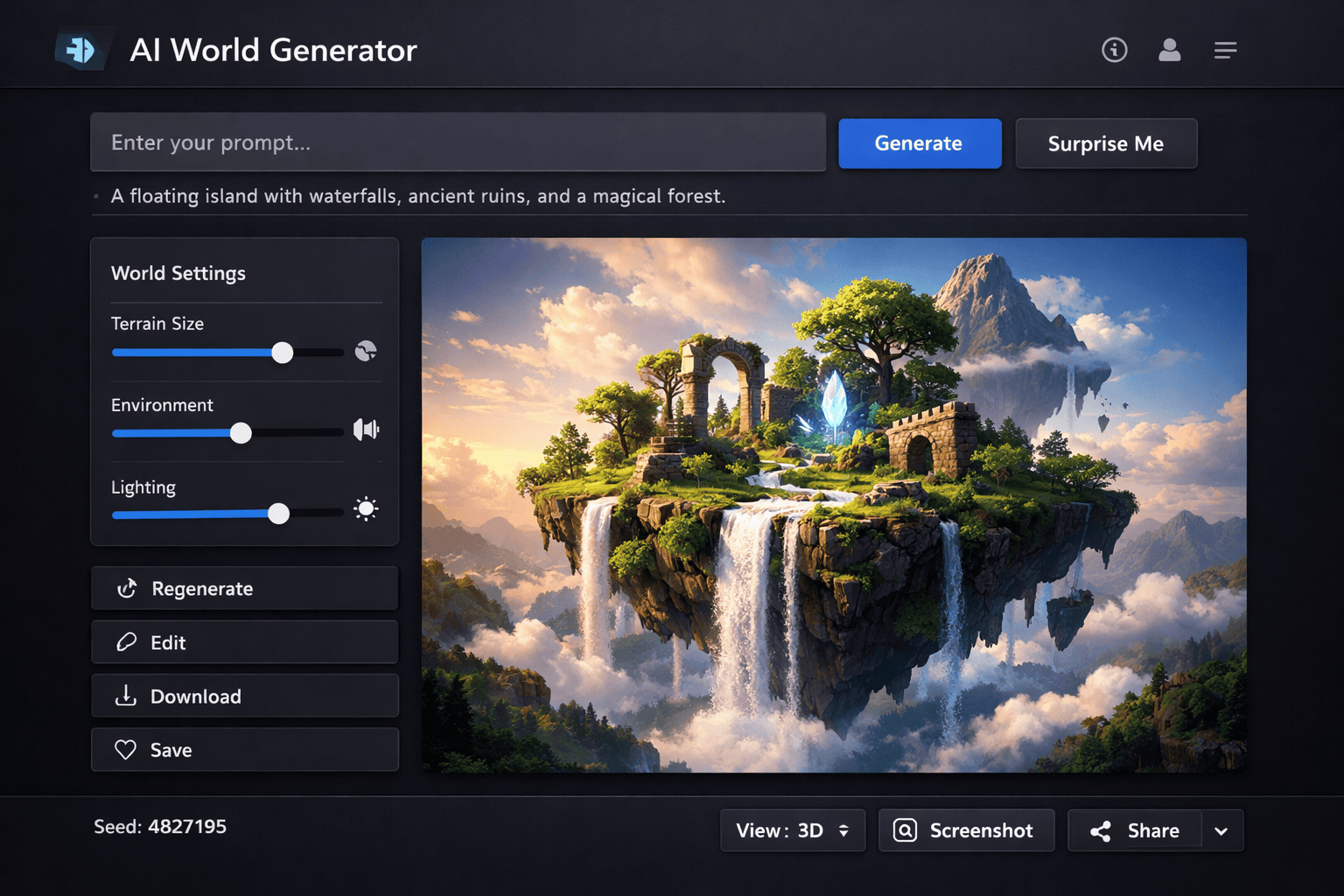

如何使用 Genie 3 — Project Genie 演示教程

如何在 Google Labs 上体验 Genie 3

通过 Project Genie 可以立即体验 Google Genie 3。以下是详细步骤:

如果尚未订阅,请先开通 Google AI Ultra。这是目前通过 Project Genie 访问 Genie 3 的唯一方式。用户需年满 18 岁且位于美国。

前往 labs.google/projectgenie 打开 Genie 3 演示。早期体验阶段无需额外消耗 AI 积分。

输入一段文字提示词,描述你想在 Genie 3 中探索的世界。尽量具体说明环境类型、光照条件、氛围以及你想出现的物体或角色。

Genie 3 生成世界后,使用键鼠控制导航。尝试可提示世界事件——输入指令改变天气、添加物体或重新混搭整个场景。

访问范围将逐步扩大

Google 已确认 Project Genie 和 Genie 3 的访问权限将扩展到美国以外的更多地区。目前尚未公布 Google Genie 3 更大范围推广的具体时间表。

Genie 3 提示词技巧:如何生成更好的世界

为 Google Genie 3 编写有效提示词需遵循 DeepMind 推荐的双层结构:

在提示 Genie 3 时详细描述环境。包括场地类型、时间段、天气条件、光照效果、关键物体和整体氛围。示例:"清晨雾气笼罩的中世纪村庄,鹅卵石街道,摇曳的灯笼,木制集市摊位,远处山丘上的城堡。"

为 Genie 3 世界定义你的角色。指定外观、服装、配饰和镜头视角。示例:"穿银色盔甲披红斗篷的骑士,第三人称镜头从身后跟随。"这有助于 Genie 3 在整个探索过程中渲染一致的角色形象。

进入 Genie 3 世界后,使用文本指令触发动态变化。尝试输入"发起一场雷暴"、"生成一条飞越头顶的龙"或"将季节切换为秋天"等提示。Genie 3 会将这些作为可提示世界事件实时处理。

Genie 3 与 AI 视频创作

Genie 3 和 AI 视频生成是两种正在融合的技术。Genie 3 创建可探索的交互式 3D 世界,而 SoraVideo.art 等 AI 视频生成器则将文本提示转化为精美的电影级片段。两者共同代表了 AI 生成视觉内容的两个方面。

设想这样的工作流程:先用 Genie 3 原型化场景的环境和氛围,再将视觉方向输入 AI 视频创作工具以产出最终的电影级成片:

- 用 Genie 3 探索 — 生成并导航世界,确定最终视觉风格。

- 截取参考帧 — 从 Genie 3 会话中截取关键角度和光照设置。

- 生成电影级视频 — 将参考帧作为视觉提示,配合详细的 Sora 2 提示词产出可直接播出的素材。

这套 Google Genie 3 加 AI 视频的完整管线,弥合了交互探索与成品内容之间的鸿沟。

Genie 3 技术报告与论文

截至 2026 年 1 月,Genie 3 尚未发布正式的同行评审论文。Google Genie 3 的技术细节来源如下:

- Google DeepMind 官方博客文章(2025 年 8 月 5 日)

- deepmind.google 上的 Genie 3 模型页面

- DeepMind 发布的 Genie 3 提示词指南

初代 Genie 1 论文 ——"Genie: Generative Interactive Environments"——可在 arXiv 上获取(arXiv:2402.15391,2024 年 2 月)。该 Genie 论文奠定了 Genie 3 所继承的潜在动作模型和自监督学习方法的基础。

期待专属 Genie 3 技术报告的研究者和开发者,可持续关注 DeepMind 的出版物页面以获取 Genie 3 论文的最新动态。

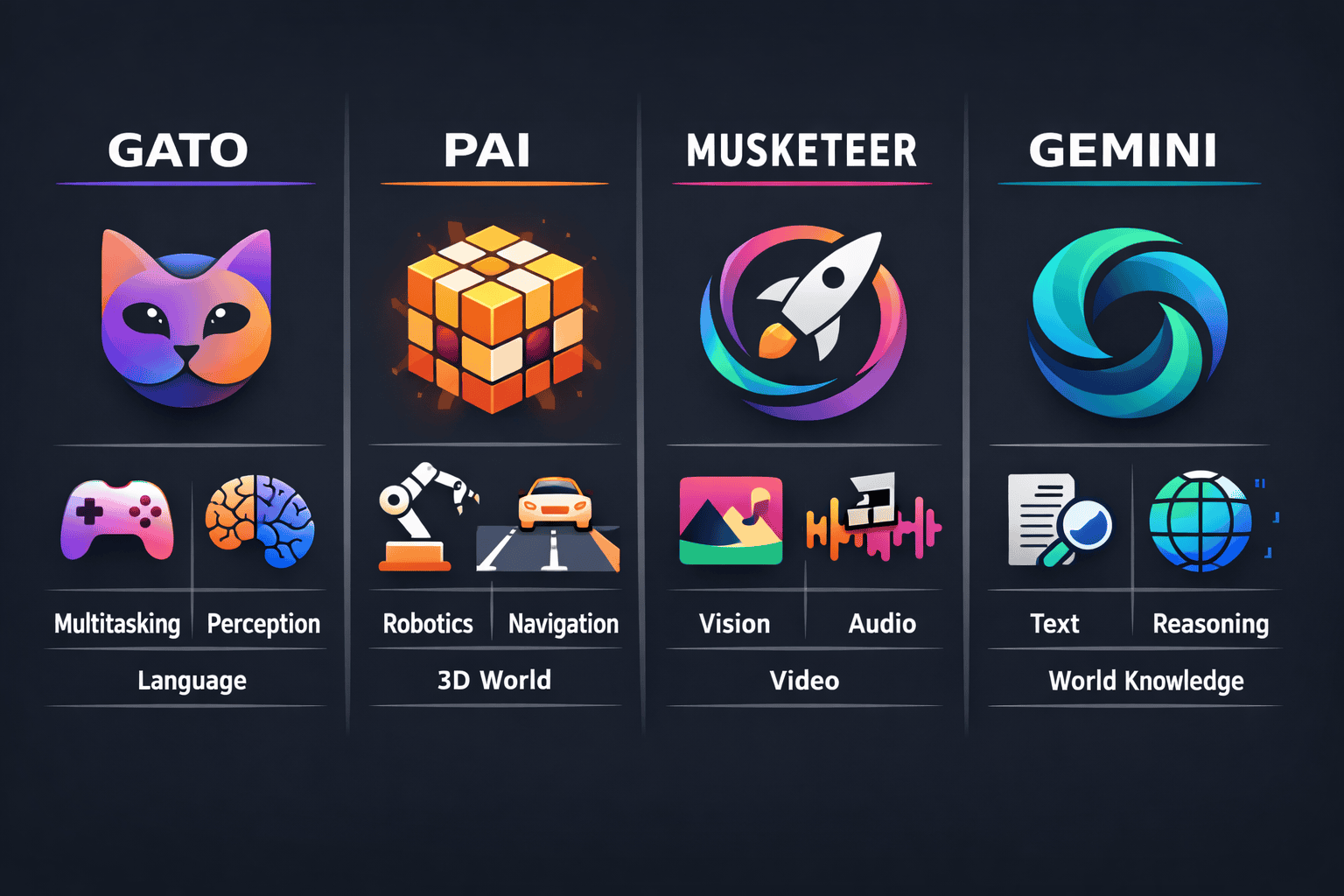

Google Genie 3 与其他 AI 世界模型对比

Google Genie 3 与竞争对手相比表现如何?以下是详细对比:

| 模型 | 开发方 | 主攻方向 | 核心优势 | 访问方式 |

|---|---|---|---|---|

| Genie 3 | Google DeepMind | 通用交互式世界 | 首个实时世界模型,自学物理引擎 | Google AI Ultra(美国) |

| NVIDIA Cosmos | NVIDIA | 物理 AI、机器人、自动驾驶 | 物理感知生成,商业许可 | 开放权重 |

| Marble | World Labs(李飞飞) | 商用世界生成 | 首个商业化可用世界模型 | 免费至 $95/月 |

| Oasis | Decart | 游戏(类 Minecraft) | 直接商业化为可玩游戏 | 公开 |

Google Genie 3 凭借实时交互性和通用性脱颖而出。NVIDIA Cosmos 聚焦工业仿真,Marble 专注商用 3D 内容,而 DeepMind Genie 3 志在成为跨领域的通用世界模拟器——从游戏到机器人训练再到创意探索。

关于 Genie 3 的常见问题

Genie 3 是什么? Genie 3 是 Google DeepMind 的基础世界模型,能够根据文本或图像提示以 24 fps 实时生成可交互、可导航的 3D 环境。

如何使用 Genie 3? 通过 Google Labs 上的 Project Genie 访问 Genie 3。你需要订阅 Google AI Ultra 并位于美国。前往 labs.google/projectgenie 即可体验 Genie 3。

Genie 3 可以免费使用吗? Genie 3 需要 Google AI Ultra 订阅。但在早期体验阶段,通过 Project Genie 使用 Google Genie 3 无需额外消耗 AI 积分。

Genie 3 何时发布的? DeepMind Genie 3 于 2025 年 8 月 5 日宣布。面向消费者的 Project Genie 演示于 2026 年 1 月 29 日上线,首次让公众可以体验 Genie 3。

Genie 3 有技术论文吗? 目前尚未发布正式的 Genie 3 论文。Genie 1 论文(arXiv:2402.15391)描述了基础架构。Genie 3 的技术细节可在 DeepMind 博客和 Genie 模型页面获取。

Genie 3 能创建 3D 模型吗? Genie 3 生成的是交互式 3D 环境,而非可导出的 3D 模型文件。这些世界存在于 Genie 3 运行时中,供实时探索,而非下载为独立资产。

Genie 2 和 Genie 3 有什么区别? Genie 2 生成的是 10–20 秒的非实时 3D 短片段。Genie 3 提供 24 fps 的完整实时交互体验,拥有扩展视觉记忆、文本生成世界和可提示世界事件——相对 Genie 2 是跨代提升。

美国以外能体验 Google Genie 3 吗? 目前通过 Project Genie 使用 Google Genie 3 仅限美国。Google 已确认计划扩大 Genie 3 的可用范围,但尚未公布国际访问的具体 Genie 3 上线日期。

等待 Genie 3 开放?先来创作 AI 视频

在 Genie 3 扩大开放的同时,今天就可以开始创作惊艳的 AI 视频内容。SoraVideo.art 将电影级 AI 视频生成带到你的浏览器——无需等待名单,不受地区限制。把你的创意在几秒内变为精美视频。

更多文章

我用 60 秒做出了第一支 AI 视频 — 你也可以

了解 SoraVideo.art 如何将 Sora 2 的全部能力带入你的浏览器。无需复杂配置,无需每月 200 美元订阅 — 只需输入创意,AI 即刻生成电影级画质视频。

如何去除 Sora 2 水印:2026年5种真正有效的方法

详细教程:如何去除 Sora 2 视频水印。我们测试了 Reddit 上的建议、CapCut 和专业工具,为你找到最佳的 Sora 水印去除方案。

Kling 3.0 AI 视频模型即将发布 — 功能、发布日期与抢先体验

Kling 3.0 是快手推出的下一代 AI 视频模型。了解 Kling 3 的核心功能,对比 Kling AI 与 Veo 3,并在 kling-3.org 抢先体验 Kling 3 模型。

邮件列表

加入我们的社区

订阅邮件列表,及时获取最新消息和更新